微调Segment Anything 2 (SAM 2)

微调Segment Anything 2 (SAM 2)

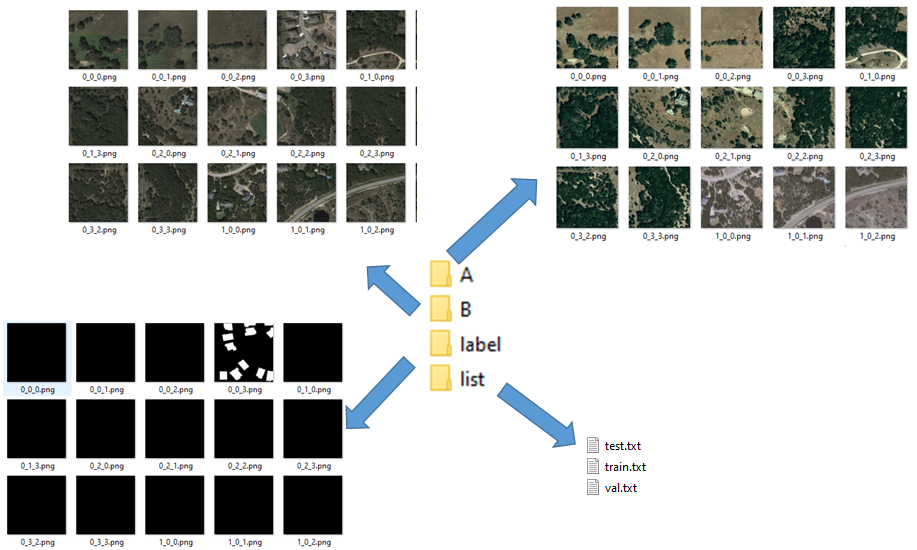

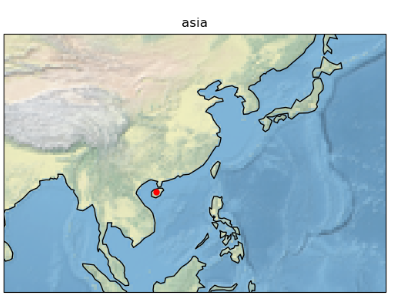

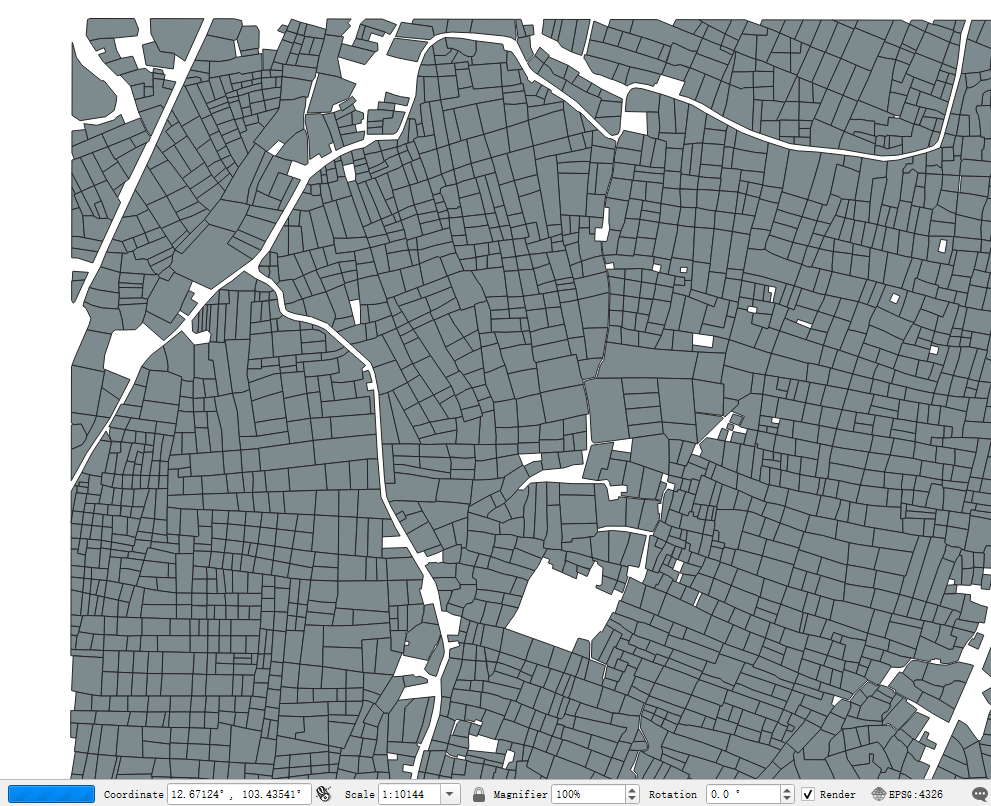

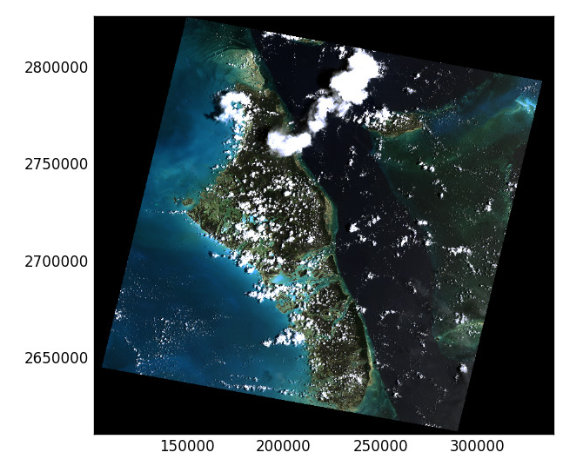

ytkzSAM2(Segment Anything 2)是 Meta 推出的一款新模型,旨在分割图像中的任何内容,而不局限于特定的类别或领域。该模型的独特之处在于其训练数据规模:1100 万张图像和 110 亿个掩码。这种广泛的训练使 SAM2 成为训练新图像分割任务的强大起点。

您可能会问,如果 SAM 可以分割任何东西,为什么我们还需要重新训练它?答案是 SAM 非常擅长处理常见物体,但在罕见或特定领域的任务上表现不佳。

但是,即使在 SAM 给出的结果不足的情况下,仍然可以通过在新数据上对其进行微调来显著提高模型的能力。在许多情况下,这将比从头开始训练模型需要更少的训练数据并获得更好的结果。

本教程演示了如何在仅 60 行代码(不包括注释和导入)中对新数据上的 SAM2 进行微调。

完整的训练脚本可以在以下位置找到:

完整代码: