口算深度学习模型有多少个参数

口算深度学习模型有多少个参数

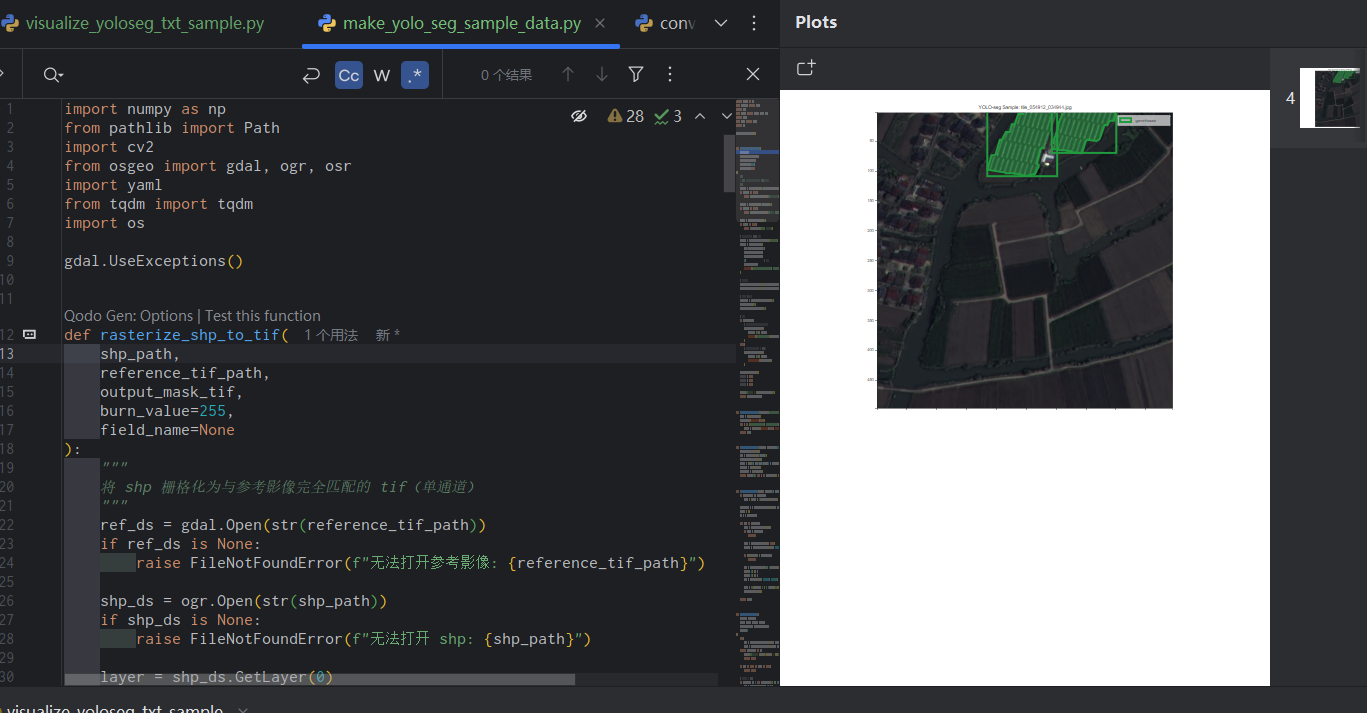

ytkz在深度学习中,PyTorch 的 .pth 文件常用于保存神经网络的模型权重(state_dict)。当我们看到一个 .pth 文件时,可能会好奇:这个模型到底有多少参数?

下面分为两部分,正推和反推。

正推

假设我的模型有一百万个参数,那么我的pth模型多大?

在 PyTorch 中,模型参数通常以 32 位浮点数(float32)存储,每个参数占用 4 字节(32 bits ÷ 8 bits/byte = 4 bytes)。

因此,存储所有参数所需的总字节数为:

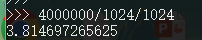

1,000,000 参数 × 4 字节/参数 = 4,000,000 字节

转换为 MB:

4,000,000 字节 ÷ (1024 × 1024) = 4,000,000 ÷ 1,048,576 ≈ 3.81 MB

基于上述计算,假设 .pth 文件只保存模型参数(state_dict),文件大小约为 3.81 MB。加上少量的元数据,实际大小可能略高于此值,但通常略比3.81mb大一些。

反推

假设.pth 文件是100MB,那她可能有个多少参数?

1. 文件大小转换

100MB 的文件大小需要转换为字节:

100 MB = 100 × 1024 × 1024 字节 = 104,857,600 字节2. 参数数量估算

每个参数以 float32 存储,占用 4 字节。因此,参数数量为:

参数数量 = 文件大小 ÷ 每参数字节数

= 104,857,600 ÷ 4

= 26,214,400 参数3. 考虑元数据

.pth 文件除了参数外,还包含一些元数据(如层名称、模型结构等),通常占用几 KB 到几十 KB。假设元数据占用 100KB(即 102,400 字节),实际用于参数的字节数为:

104,857,600 - 102,400 = 104,755,200 字节重新计算:

参数数量 = 104,755,200 ÷ 4 ≈ 26,188,800 参数4. 其他因素

- 优化器状态:如果 .pth 文件保存了优化器状态(如 Adam 的动量和方差),每个参数可能需要额外的存储空间(通常是参数数量的 2 倍)。这会显著减少实际的参数数量。例如,若文件包含优化器状态,参数数量可能接近 870 万。

- 压缩:PyTorch 的 .pth 文件通常未压缩,因此文件大小直接反映参数存储需求。如果使用了压缩(如 .pth.tar.gz),需要解压后计算。

在本例中,假设 .pth 文件只保存模型权重(state_dict),我们估算模型有 约 2618.88 万个参数。

实际意义

以 100MB 的 .pth 文件为例,2618.88 万个参数对应一个中等规模的神经网络。例如:

- 一个简单的 U-Net 模型(用于图像分割)可能有 2000 万到 3000 万个参数。

- 相比之下,ResNet-50 约有 2500 万个参数,而大型语言模型(如 GPT-3)可能有数百亿个参数,文件大小达数 TB。