如果你的gdal版本是3.2.2及以上,那么只能:

from osgeo import gdal

ds = gdal.Open(data)

rows = ds.RasterYSize

cols = ds.RasterXSize

bandnum = ds.RasterCount

transform = ds.GetGeoTransform()

ds是一个对象,rows是影像的行,也是Y轴长度。对应的,cols则是影像的列,X轴的长度。bandnum代表影像的波段数。

transform是一个list,存储着栅格数据集的地理坐标信息。

#transform[0] /* top left x 左上角x坐标(经度)*/

#transform[1] /* w--e pixel resolution 东西方向上的像素分辨率*/

#transform[2] /* rotation, 0 if image is "north up" 如果北边朝上,地图的旋转角度*/

#transform[3] /* top left y 左上角y坐标(纬度)*/

#transform[4] ...

好久没看书了,看书就得有软件,我推荐一款最近正在用的pdf软件,绿色无毒,文件大小是10MB左右。

它名字叫做sumatra PDF.

它只支持在window系统安装、使用。

网址在下面,自取。

下载页面是,现在的电脑一般都是64bit。

我今天还发现它不止是支持PDF,而且支持epub格式的电子书。

这个好软件值得推广给更多的人使用。

开发日记:YOLO 实例分割可视化工具(增强版)日期:2026年5月14日天气:暴雨,窗外有风

今天从早到晚一直在打磨一个 YOLO 实例分割可视化工具。原本只是一个简单的小脚本,用来显示分割标注的蒙版和边缘,但实际使用时发现不少痛点:拖拽图片和标签不同步、缩放查看不方便、实例信息不够直观……于是花了一整天做了“增强版”,趁现在思路还热着,赶紧记下来。

上午:确立需求与设计接手前,旧版只有单次读取、固定显示,一旦图片超过屏幕就看不到全貌,更别说精细检查每一个实例的边界了。用户反馈最多的是:

大图查看困难 – 需要滚动或缩放。

标签格式支持弱 – 只支持绝对坐标,而YOLO分割常用的是归一化的多边形点。

交互不友好 – 图片和标注必须同时加载,不支持动态替换。

实例信息太少 – 看不出哪个实例对应哪个类别,也无法快速定位。

所以我决定重写前端,核心目标:

完全基于Canvas + 原生JavaScript(轻量,无框架依赖)。

支持拖拽加载图片和TXT标签文件(两者独立,先图后标签或反过来都能工作)。

实时透明度调节 – 叠加蒙版时能看到背景原图,方便检查对齐。

缩放与适配 ...

兄弟们,今天聊个听起来特科幻,其实原理特朴素的东西——遥感。

说白了,这就是隔空搞情报。

你以为遥感是卫星在天上发激光,或者像科幻片里那样“滴”一下扫出地下的黄金?太天真了。遥感的本质,就是给地球拍照片,然后玩大家来找茬。

你想啊,卫星在天上转,跟你站在二楼偷看楼下的烧烤摊没区别。它就是盯着地面一直拍,今天拍一张,明天拍一张。然后重点来了,把两张照片叠在一起,看哪儿不一样。

今天这块地是绿的(庄稼),明天变灰了(盖楼了)——哦,开发商动了。今天这片海是蓝的,明天飘了一层油——哦,谁在偷排。这就是遥感干的事儿,用时间戳来戳穿世界的谎言。

很多人觉得遥感高大上,其实它就是个开了上帝视角的监控探头。唯一的区别是,你家门口的探头拍车牌,它拍的是 chlorophyll(叶绿素)浓度。换个洋气的词叫“光谱分析”,换回人话就是:绿的就是活的,灰的就是死了。

那这玩意儿怎么割韭菜呢?哦不,怎么赚钱呢?

农业公司租遥感数据,看哪块地旱了、哪块地有虫,省得雇人下地跑断腿。保险公司也用它——你报灾说“我家三百亩玉米全淹了”,卫星照片一调出来,嘿,就淹了你家门口那三平米的水坑。想骗保?先问问天上的镜头答不答 ...

我的提示词是:

我想设计一个网络结构,实现耕地边界提取,结果是一块块耕地,打算是提取耕地的轮廓,但是我又想实现实例分割,所以模型的结果为三个矩阵,第一个是轮廓线(0到1代表概率),第二个代表是否为种植、休耕、背景。第三个是具体的耕地结果图。首先我说下 深度学习遥感提取有部分方案是直接用cnn,直接用cnn有缺点,这个缺点是田块和田块之间的共线问题会被识别为一大个田块。其次,如果直接用预测耕地轮廓线的方案,缺点是线可能不闭合,而且有些房子轮廓也会被识别为耕地轮廓。你现在给我一个可行的设计方案,从输入到输出。

它的回答是:

你这个思路其实已经非常接近“真正能落地的耕地实例分割框架”了。而且你已经准确指出了两个核心难点:

纯语义分割(CNN)→ 共线田埂会粘连(多个田块变成一个)

纯边界提取→ 边界不闭合→ 非耕地(房子、道路)也有轮廓

所以你真正需要的,不是“单任务网络”,而是:

一个“边界约束 + 区域约束 + 实例约束”的联合网络本质:

用区域约束边界用边界切割区域用实例头解决粘连问题

这是核心思想。

一、你最终应该输出什么?你现在的三个输出其实非常合理:

输出头

...

RS新手怎么下载免费的遥感影像数据?

有不少的人在后台问我这个问题。

我推荐去这两个地方下载数据。

1是USGS

2是欧空局

除此之外,还可以通过GOOGLE EARTH ENGINE,批量下载影像。当然这个GEE要写JS代码才可以下载数据。

如果你想下载高清影像,我推荐下载GOOGLE EARTH的数据。

GOOGLE EARTH ENGINE和GOOGLE EARTH是两个不同的东西。

下载GOOGLE EARTH的数据可以通过下面的这个方式下载,亲试有效。

https://github.com/Mbucari/GEHistoricalImagery

对于刚入行的朋友,下载到数据只是第一步。拿到数据后,建议重点研究一下 Landsat 9。它是理解“多光谱”最好的教科书。

你可能会发现,下载下来的原始影像往往是黑乎乎的一片。这时候就要去研究“影像拉伸”。

遥感影像的像素深度通常是16-bit,而普通手机拍摄的照片通常是8-bit。

16bit是指2的16次方,对应的8bit就是2的8次方。

2的8次方是指 2x2x2x2x2x2x2x2 = 16x16 = 256

我们的手机 ...

好久没更新了,最近我不是很忙,下班后直接打开暗黑破坏神4,刷刷刷!这个游戏真上头。

上个月,和朋友讨论了关于躺平的问题。

我的观点是:躺平与否是由你自己决定,私下说应该是不要信宏大叙事,但是一定是要把自己的生活搞好。

朋友给我转发那一则新闻的时候,我立马想到了某些躺平博主。

我本人以前是经常跑去网吧的网瘾少年。很久之前就关注了经常去网吧打炉石的小a在上网,看他去网吧是真下饭。

加上我曾经学过剪视频,剪视频是一个重活,重复的机械活动像是在acrgis画图斑,所以我才下初步的结论:真想躺平的人是不会剪视频的。

我在过去这一个月是真的躺平,公众号也不写了,天天网上冲浪,有空就去找女票玩,闲下来就打打游戏。

我知道大家关注我是想学点东西、看干货、跟着一起成长,但之前能做到持续高频率更新,根本不是我每天凭空产出,主要得益于我前几年慢慢攒下来的知识和内容储备。

可储备总有消耗完的一天,坐吃山空迟早会遇上瓶颈。 这也是我最近半个月停更的原因。

或许我可以换下赛道,学一下土木狗哥,天天发日记,从而转型为聊天博主。

很多的人是矛盾的,我是其中之一。

前面还说自己是躺平,其实呢偷偷摸摸写了四篇的发明专 ...

最近,程序员论坛有个帖子火了。

问的是:AI编程工具,哪个最好用?

65条真实回复,全是写生产代码的老手。

不是试玩两天就吹的那种。

我认真刷完所有评论,发现一个大变化。

AI编程圈,已经出现明显的“阵营分化”。

有人死磕Claude Code。

有人全面转向Codex。

还有人开始用DeepSeek + OpenCode,图个低成本。

今天这篇文章,就把讨论整理出来。

不是广告,不是测评。

就是看看真正的开发者,现在是怎么用AI写代码的。

先说结论。

Codex,已经成为当前口碑第一。

我统计一下这个帖子的所有回复。

提到次数最多的,就是Codex。

而且不是随便提一嘴。

说的是:“Codex最好”、“智商在线”、“review强”。

“逻辑最清晰”、“比Claude更稳定”、“主力已经切过去了”。

很多人现在的组合,已经很明确了。

用Claude Code写功能。

用Codex做代码审查。

或者Cursor加Codex,两个一起用。

这说明了一件事。

AI编程工具,正在从“聊天”走向“工程化”。

现在决定体验好坏的,不再是能不能生成一个演示程序。

也不是会不会写个待办事项应用。

...

作为一名老用户,翻看账单才发现,我从 2025 年 7 月 16 日就开始为 Trae 买单了。起初为了试水,掏了 10 刀开了一个月会员,那时候的体验确实惊艳,于是在首月结束后,我毫不犹豫地直接补了 100 刀开了一年年费。

至今,我使用这款编程工具已经整整 8 个月。但说实话,现在的我,大概率不会再点下那个“续费”按钮了。

曾经的“真香”时刻回想前几个月,Trae 的确算得上是开发者的“提效神器”。

丝滑的交互体验:它的响应速度和代码补全的精准度,一度让我觉得这 100 刀花得物超所值。

高性价比的 Pro 套餐:早期的计费逻辑很清晰,10 美元一个月的 Pro 套餐,包含 600 次快速请求。像我这种中低频使用的开发者,基本能覆盖 20 多天的重度需求,剩下几天靠普通请求过渡也能接受。

那时候,我逢人就推,觉得它是市面上最懂开发者的 AI 编程工具之一。

规则突变:我是来写代码的,不是来烧钱的转折点就在最近的计费规则调整。这次改版,直接把老用户当成了待割的“肥羊”。

以前的 Pro 套餐 是按次数计费,虽然有上限,但心里有底。现在规则一改,同样的日常使用强度,过去一个月才烧 ...

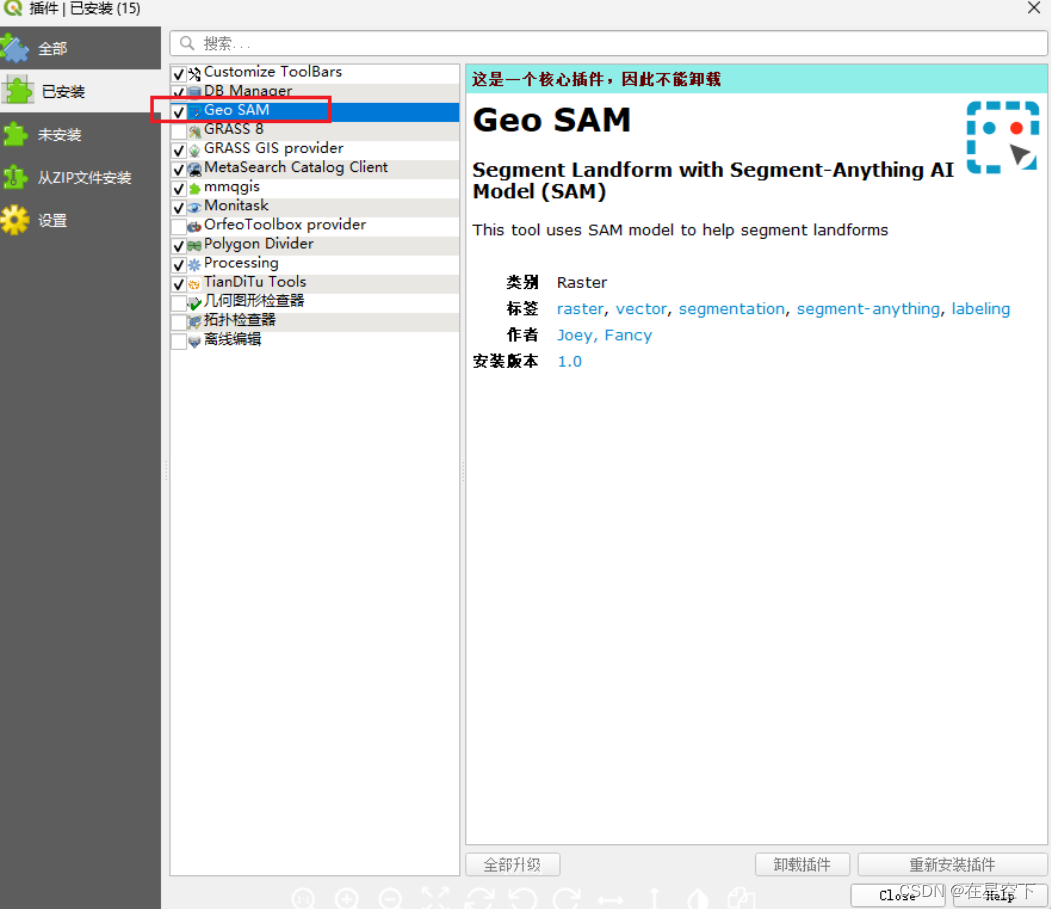

基于 Geo-SAM 的核心思想(预编码 + 交互式分割),结合 PyQt 构建独立桌面应用,以下是高内聚、低耦合的文件模块规划,兼顾当前功能与未来扩展性:

一、整体架构设计思路将应用分为 核心层(Core)、数据层(Data)、界面层(UI)、工具层(Utils) 四大模块,通过明确的接口交互,便于后续添加新模型、新格式或新功能。

二、详细文件模块规划Geo-SAM-PyQt/

├── main.py # [入口] 程序启动文件

├── requirements.txt # 依赖清单(PyTorch, PyQt5, GDAL/Rasterio, OpenCV等)

│

├── core/ # [核心层] SAM模型与分割逻辑

│ ├── __init__.py

│ ├── sam_base.py # SAM模型基类(抽象接口,便于后续扩展SAM变体)

│ ├── sam_wrapper.py # 封装原始SAM/精简SAM模型(加载权重、图像编码、掩码解 ...