波段反了,模型废了

波段反了,模型废了

ytkz啥是波段顺序?

想象一下,一张遥感图像不是普通的照片,它有好多“层”——这些层叫“波段”(bands)。每个波段捕捉不同颜色的光,比如:

- R(Red):红色波段,帮你看植物的健康(因为健康的植物反射红光少)。

- G(Green):绿色波段,看植被覆盖。

- B(Blue):蓝色波段,帮分析水体或大气。

在电脑里,这些波段像三明治一样叠起来。最常见的有两种顺序:

- RGB:红-绿-蓝(这是我们眼睛看照片的自然顺序,很多图片软件默认这个)。

- BGR:蓝-绿-红(这是OpenCV这个流行库的习惯,因为历史原因)。

深度学习模型(比如用PyTorch或TensorFlow建的神经网络)在“学习”的时候,会记住这些层的顺序。比如,它会想:“第一层是蓝的特征,第二层是绿的……” 如果你训练时用BGR,但预测(就是用模型猜新图片)时喂它RGB,模型就懵了!它会把蓝当成红,绿当成蓝,结果当然乱七八糟,就像你把鞋子左右穿反了,走路肯定歪歪扭扭。

为啥训练和预测要一致?

模型的“记忆”:模型不是随便猜的,它在训练时学的是特定顺序的图案。如果你换顺序,就等于给它看颠倒的地图——它能认出来才怪!

遥感数据的特殊性:遥感图像往往不止RGB三个波段,可能有近红外(NIR)、短波红外啥的,多达几十个。顺序错了,一个小混淆就能让整个预测崩盘,比如把森林认成沙漠。

实际例子:假如你训练一个模型识别农田。训练数据是BGR顺序的,模型学会了“蓝层高的地方是水”。但预测时你用RGB(红先),模型就把红当成蓝,结果把红彤彤的土壤当成水了。预测准确率直线下降,从90%变10%不是梦!

训练BGR,预测RGB。结果不理想?太正常了!这不是模型笨,是数据喂错了。

怎么避免这个坑?

方法很简单,直接看你样本数据,最好找到一些操场,看这些操场的跑道是什么颜色。

如果是红色,说明这些样本的波段是RGB格式。

如果是蓝色,说明这些样本的波段是BGR格式。

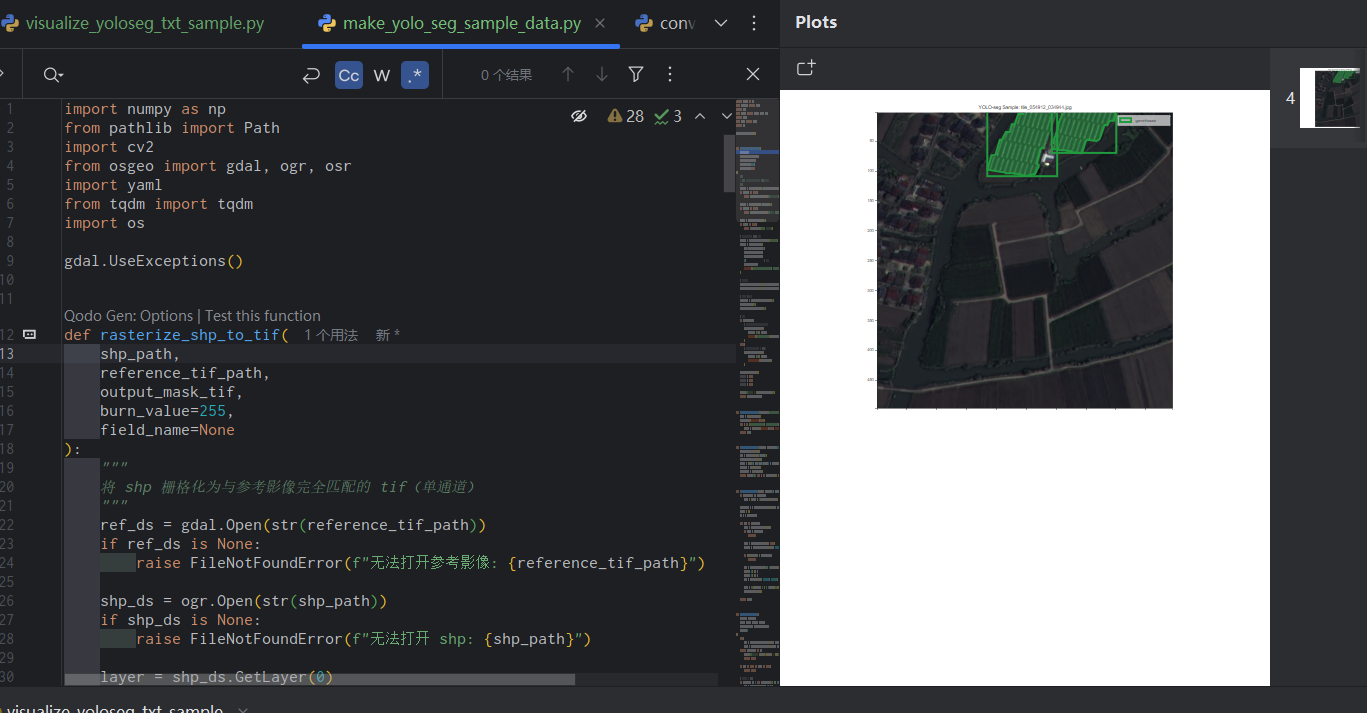

如下图的操作跑道是蓝色的,说明该样本的波段顺序是BGR。

常见小Tips,避免再踩坑

库的习惯:OpenCV = BGR,Matplotlib/PIL = RGB。混用时必转!

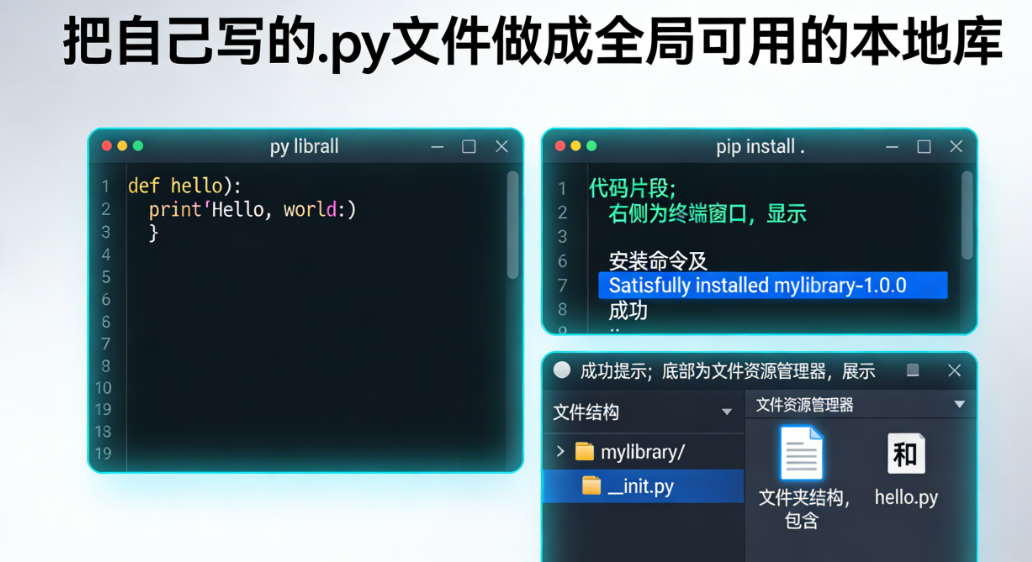

遥感专用工具:用GDAL或Rasterio处理多波段图像,它们能指定波段顺序。

调试神器:可视化!用Matplotlib画图

以上,万分感谢大家的关注和支持,明天见。